Dario Centurione fez alerta nas redes sociais e afirmou que pessoas com vozes muito presentes na internet são mais suscetíveis ao golpe; entenda. Influencer diz ter tido voz clonada por inteligência artificial e denuncia golpe contra o pai

Almanaque SOS/Reprodução

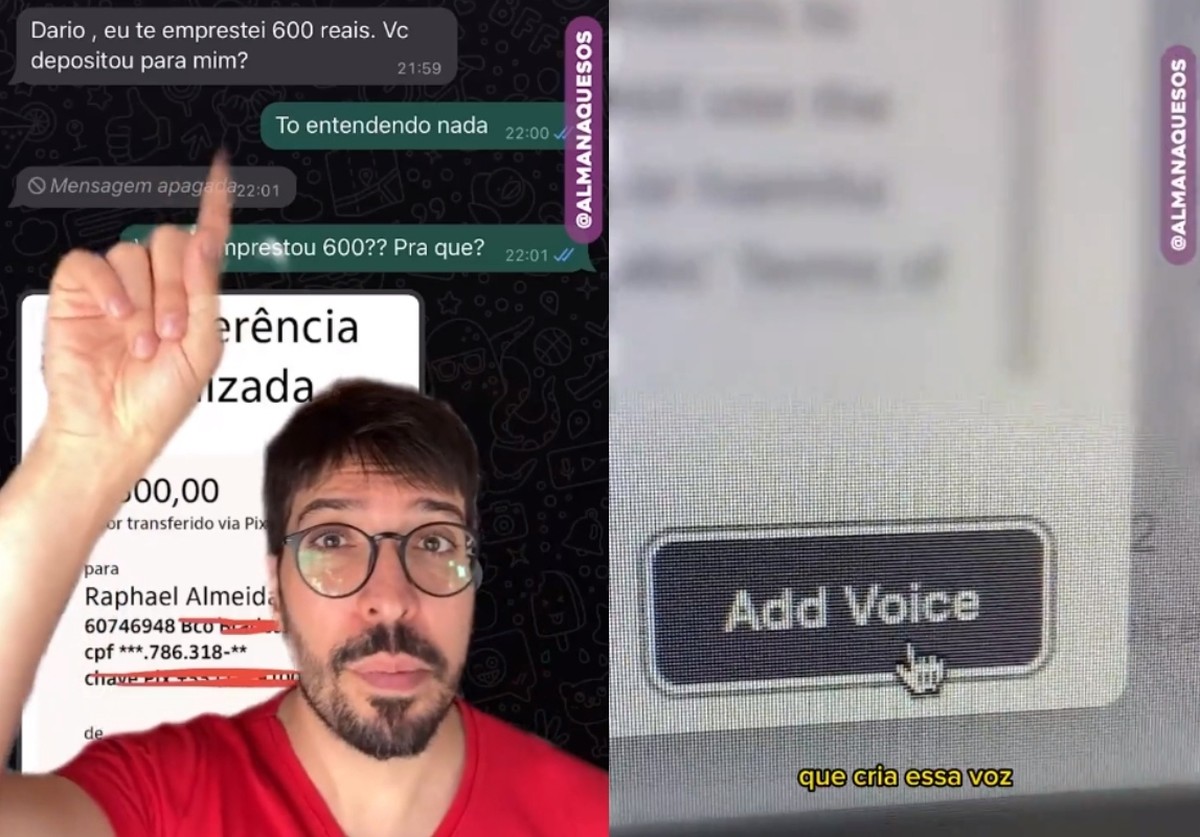

Um influencer de São Paulo denunciou nas redes sociais que teve a voz clonada por meio de inteligência artificial (IA) e que o recurso foi utilizado para aplicar um golpe no pai dele. O homem perdeu R$ 600 ao receber uma ligação, supostamente do filho, pedindo um empréstimo.

Dario Centurione divulgou o print de uma conversa que teve com o pai no WhatsApp. Nas mensagens, o pai conta que havia transferido R$ 600 para uma pessoa via Pix depois que recebeu a ligação com o pedido (veja o vídeo abaixo).

Initial plugin text

A partir da mensagem do pai, Dario desconfiou de que a voz dele havia sido clonada para a ligação e entrou em contato com um especialista, que o alertou que vozes de pessoas muito presentes na internet são mais suscetíveis a esse tipo de golpe.

De acordo com o influencer, recursos de inteligência artificial permitem usar vídeos e áudios na internet como base para a criação de novas frases com a voz parecida.

Dario, por exemplo, tem vários vídeos dele em diferentes sites e redes sociais. Ele é o criador do “Almanaque SOS”, um projeto com dicas do cotidiano para jovens, como truques de limpeza, receitas diferentes e até gambiarras para facilitar o dia a dia.

O vídeo em que Dario denunciou o golpe tinha mais de 1,4 milhão de visualizações no TikTok até a noite desta sexta-feira (12). Na postagem, o influencer também indicou a criação de uma palavra de segurança com os familiares para evitar golpes.

“Você e sua família vão escolher uma palavra que só vocês sabem e, se desconfiarem que algo está estranho, é só perguntar a palavra”, explica.

LEIA TAMBÉM:

‘Deepfake ao vivo’: tecnologia que muda rosto e voz em videochamada já existe na vida real

Golpe do amor: veja dicas para se proteger ao usar apps de relacionamento

Vazamento de dados pessoais: veja como se proteger e o que fazer se for vítima

Já ouviu falar de ‘deepfake ao vivo’?

No caso do influencer, a suspeita é de que o golpista tenha utilizado inteligência artificial para imitar a voz dele. Mas especialistas alertam que, além da voz, recursos de IA já permitem clonar o rosto de uma pessoa.

A chamada “deepfake” é uma tecnologia que permite mostrar o rosto de uma pessoa em fotos ou vídeos alterados com ajuda de inteligência artificial. Apesar disso, ela ainda precisa de aprimoramento e exige alto investimento.

Na novela “Travessia”, a história de um pedófilo que se passa por uma adolescente em videochamada é um exemplo do uso da tecnologia para o crime. Na trama, o criminoso teve seu rosto e voz modificados por um programa de computador, podendo enganar com facilidade quem o visse do outro lado.

No entanto, fazer um “deepfake ao vivo” com a qualidade mostrada na novela exige um computador potente com capacidade para processar as alterações em tempo real, explicou Fernando Oliveira, conhecido como Fernando 3D, especialista no tema e em inteligência artificial da FaceFactory. Entenda mais aqui.

E, realmente, famosos são mais suscetíveis, já que existe mais conteúdo online com rosto e voz deles.

Entenda a tecnologia:

‘Deepfake ao vivo’: tecnologia que muda rosto e voz em videochamada já existe na vida real

LEIA TAMBÉM:

Por que cientistas temem futuro catastrófico causado pela inteligência artificial

Os profissionais que temem perder seu emprego para a inteligência artificial

deepfake ao vivo